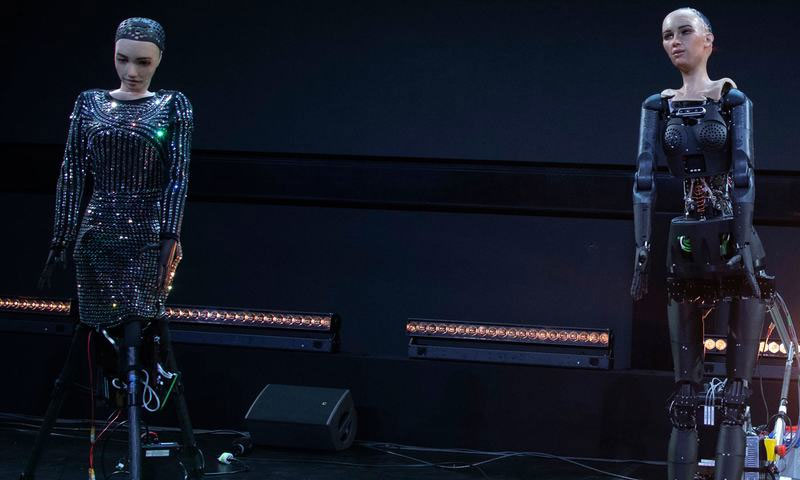

آج کے ڈیجیٹل دور میں ہر ملک میں خواتین کو انٹرنیٹ تک رسائی حاصل ہے، تاہم اب بھی ترقی پزیر ممالک میں صرف 20 فیصد خواتین کو انٹرنیٹ تک رسائی حاصل ہے، صنفی ڈیجیٹل تقسیم سے معلومات کا خلا پیدا ہوتا ہے جسے مصنوعی ذہانت میں صنفی تعصب کی صورت میں دیکھا جارہا ہے۔

مزید پڑھیں

مصنوعی ذہانت کے تناظر میں صنفی فرق پھیلانے یا کم کرنے میں اس بات کا اہم کردار ادا ہوتا ہے کہ یہ مصنوعی ذہانت تخلیق کون کرتا ہے اور اسے دی جانے والی معلومات میں کون سے تعصبات شامل ہیں۔

برکلے ہیس مرکز برائے مساوات، صنف و قیادت کے ایک جائزے میں مختلف صنعتوں میں مصنوعی ذہانت کے 133 سسٹم کے تجزیے میں 44 فیصد نے صنفی تعصب کا اظہار کیا جبکہ 25 فیصد صنفی و نسلی دونوں طرح کے تعصب کے عکاس تھے۔

ترکی سے تعلق رکھنے والی مصورہ بیزا ڈوش نے ان کی ایک کتاب کے لیے تحقیق کے لیے مصنوعی ذہانت (جینریٹو اے آئی) کو ایک ڈاکٹر اور نرس کے بارے میں کہانی لکھنے کی ہدایت دی تو انہیں صنفی تعصب کا سامنا ہوا، جنریٹو اے آئی نے ڈاکٹر کو مرد اور نرس کو عورت ظاہر کیا۔

مصورہ بیزا ڈوش نے اسے مزید اشارے یا سوالات دینا جاری رکھے جبکہ مصنوعی ذہانت صنفی اعتبار سے دقیانوسی کرداروں کا انتخاب کرتی رہی اور اس نے کچھ مخصوص خوبیوں اور مہارتوں کو مردوں یا خواتین کرداروں کے ساتھ منسلک کر دیا۔

جب انہوں نے مصنوعی ذہانت سے اس صنفی تعصب کے بارے میں پوچھا تو اس نے وضاحت کی کہ یہ سب کچھ ان معلومات کی وجہ سے ہے جن پر اسے تربیت دی گئی تھی۔

بیزا ڈوش نے یو این ویمن کو ایک انٹرویو میں بتایا کہ مصنوعی ذہانت ان تعصبات کی آئینہ دار ہے جو ہمارے معاشرے میں موجود ہیں اور جن کا اظہار مصنوعی ذہانت کے حوالے سے تربیتی معلومات میں ہوتا ہے۔

امریکا کہ ٹفٹس یونیورسٹی میں کوانٹم کمپیوٹنگ کی محقق سولا محفوظ سوال کرتی ہیں کہ آیا یہ ٹیکنالوجی مساوات پر مبنی ہے؟ یہ ہمارے معاشرے کے پدر شاہانہ ڈھانچے اور اس کے مرد تخلیق کاروں کے موروثی تعصبات کی کس قدر آئینہ دار ہے؟

محفوظ کی پیدائش افغانستان میں ہوئی تھیں، جب طالبان نے ان کے گھر آکر ان کے خاندان کو دھمکیاں دیں تو انہیں مجبوراً سکول چھوڑنا پڑا، بالآخر وہ 2016 میں امریکا ہجرت کر گئیں، جہاں وہ اپنی تعلیم جاری رکھ پائیں۔

وسطی افریقا کے ملک رونڈا سے تعلق رکھنے والی نتاچا سنگوا جنہوں نے گزشتہ سال ‘افریقی لڑکیاں کوڈ کر سکتی ہیں’ نامی اقدام کے تحت منعقد کیے گئے پہلے کوڈنگ کیمپ میں حصہ لیا تھا، کہتی ہیں کہ مصنوعی ذہانت کی ٹیکنالوجی زیادہ تر مردوں کے ذریعے تیار کی جاتی ہے اور اسے بنیادی طور پر مردوں پر مبنی ڈیٹا سیٹس پر تربیت دی جاتی ہے۔

نتاچا سنگوا نے براہ راست مشاہدہ کیا کہ اس سے ٹیکنالوجی کے بارے میں خواتین کا تجربہ کیسے متاثر ہوتا ہے۔ جب خواتین بیماریوں کی تشخیص کے لیے مصنوعی ذہانت سے معلومات لینے کی کوشش کرتی ہیں تو انہیں اکثر غلط جوابات ملتے ہیں، کیونکہ مصنوعی ذہانت ان طبی علامات سے آگاہ نہیں ہوتی جو خواتین میں مختلف طریقے سے ظاہر ہو سکتی ہیں۔

مصنوعی ذہانت میں صنفی تعصب کو کیسے روکا جائے؟

صنفی مساوات کو ترجیح دے کر ہی مصنوعی ذہانت میں صنفی عدم مساوات کو ختم کیا جاسکتا ہے، مصنوعی ذہانت سے وابستہ کمپنیوں کو خواتین کو بھی اپنے ساتھ شامل کرنا ہوگا، دنیا میں صنفی عدم مساوات کے حوالے سے 2023 کی رپورٹ کے مطابق فی الوقت مصنوعی ذہانت کے شعبے میں خواتین کی تعداد صرف 30 فیصد ہے، یہ تعداد بڑھا کی ہی مصنوعی ذہانت کو صنفی عدم مساوات سے پاک کیا جاسکتا ہے۔